機器人模仿學習 (Imitation learning; IL) 技術是透過觀察人類示範來訓練機器人,但受限於數據收集的規模和效率。傳統方法依賴昂貴且複雜的硬體設備,難以普及。為此,蘋果與科羅拉多大學波德分校的研究團隊開發了ARMADA系統,利用Apple Vision Pro實現更直觀、高效的機器人訓練。

|

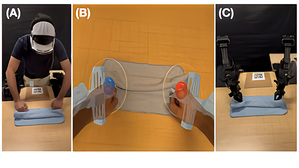

| (A) 戴著 Apple Vision Pro 的示範者直接用手來收集數據。(B) Vision Pro透過AR將機器人即時執行的動作疊加在使用者手上。(C) 直接在實體機器人上重播。(source:marktechpost) |

傳統的模仿學習系統通常需要人類操作機器人,雖然有效但面臨許多限制。這些系統仰賴透過手套、動作捕捉和虛擬實境 (VR) 裝置進行遠程操作,需要複雜的設置和低延遲控制迴路。此外,它們還依賴實體機器人和特殊用途硬體,難以擴展應用。

儘管機器人可以使用這些方法收集的專家數據執行諸如插入電池或繫鞋帶之類的任務,但對特殊設備的需求使得這些方法在大規模或更廣泛的應用中不切實際。

為了克服這些挑戰,來自蘋果公司和科羅拉多大學波德分校的研究團隊提出了一種名為 ARMADA 的創新系統。該系統將 Apple Vision Pro 頭戴式裝置與外部機器人控制系統結合,利用 ROS 和 WebSockets 的組合實現設備間的通訊。

這種設置讓系統具備隨插即用的特性,並且只需替換 3D 模型檔案和頭戴式裝置的數據格式,即可靈活適用於各種機器人平台,例如 Franka 和 UR5。ARMADA 應用程式負責處理機器人視覺化、數據儲存和使用者介面,接收機器人連結的轉換框架、捕捉來自攝影機的影像幀,以及追蹤人體骨骼數據以進行處理。機器人節點則負責管理控制、數據儲存和約束計算,將骨骼數據轉換為機器人指令,並檢測工作空間違規、奇異點和速度問題,以提供即時反饋。

透過 visionOS 2.0 中的 ARKit,系統可以追蹤人類手腕和手指的位置,並利用反向運動學來計算關節位置和控制基於手指間距的夾爪,從而使機器人的動作與人類的手部動作保持一致。此外,系統會透過顏色變化、虛擬邊界或螢幕文字來視覺化奇異點、工作空間限制和速度違規等約束條件。

研究人員使用 ARMADA 系統執行了三項任務:從盒子中取出紙巾、將玩具放入紙箱以及用雙手擦拭桌子。評估結果顯示,反饋視覺化顯著提高了「取出紙巾」、「整理雜物」和「雙手擦拭」等任務的重播成功率,與沒有反饋相比,提升幅度高達 85%。

總而言之,ARMADA 系統透過使用擴增實境提供即時反饋來提高數據質量和與實體機器人的兼容性,解決了機器人模仿學習中可擴展數據收集的挑戰。研究結果顯示了反饋對於將無機器人示範與真實機器人運動學對齊的重要性。儘管該研究專注於較簡單的任務,但未來的研究可以探索更複雜的任務並改進技術。該系統可以作為未來機器人研究的基準,特別是在透過視覺觀察進行模仿學習來訓練機器人控制策略方面。