NVIDIA(輝達)今日宣布推出採用NVIDIA Hopper架構的新一代加速運算平台,效能較上一代平台呈指數級成長。這個以美國電腦科學家先驅Grace Hopper命名的全新架構,將接替兩年前推出的NVIDIA Ampere架構。

|

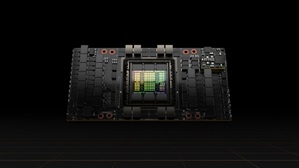

| NVIDIA H100為每個資料中心提供突破性的效能、可擴展性與安全性 |

NVIDIA亦宣佈推出首款採用Hopper架構的GPU產品NVIDIA H100,這款GPU封裝了800億個電晶體,是全球最大且效能最強大的加速器,具突破性的功能,例如革命性的Transformer Engine及具高度擴展性的NVLink互連技術,可用於推動極大規模的AI語言模型、深度推薦系統、基因組學和複雜的數位孿生等領域的發展。

NVIDIA創辦人暨執行長黃仁勳表示:「資料中心將成為AI工廠,用來處理海量資料並從中提煉出寶貴的智慧。NVIDIA H100是全球AI基礎設施的引擎,讓企業得以加速推動各項AI業務的進展。」

NVIDIA H100 GPU為加速大規模AI及高效能運算樹立了新標準,並帶來六項突破性創新:

全球最先進的晶片:H100擁有800億個電晶體,採用台積電4N製程、專為滿足NVIDIA加速運算需求而設計,在加速AI、高效能運算、記憶體頻寬、互連和通訊方面具有重大進展,包括每秒近5TB的外部連接速度。

H100是首款支援PCIe Gen5及首款使用HBM3的GPU產品,提供每秒3TB的記憶體頻寬。20個H100 GPU便足以支撐全世界的網路流量,讓客戶得以運行先進的推薦系統和大型語言模型,即時使用各項資料進行推論。

全新Transformer Engine:Transformer已是自然語言處理的首選標準模型,是史上最重要的深度學習模型之一。相較於前一代產品,H100加速器的Transformer Engine能夠將這些網路的速度提高六倍,又不失其精度。

第二代安全多執行個體GPU:多執行個體GPU(Multi-Instance GPU;MIG)技術可以將一個GPU分割成七個較小、完全隔離的執行個體以處理各類工作。Hopper架構在雲端環境裡為每個GPU執行個體提供安全的多租戶配置,將MIG的能力較前一代擴大高達七倍。

機密運算:H100是全球首款具有機密運算能力的加速器,可以在處理AI模型和客戶資料時加以保護。對於醫療照護和金融服務等對隱私極為敏感的產業,在進行聯邦學習時同樣能運用機密運算,在共享的雲端基礎設施上也同樣可行。

第四代NVIDIA NVLink:為加快最大型AI模型的運作速度,以NVLink搭配全新的外部NVLink交換器,將NVLink當成伺服器以外的垂直擴展網路,相較於使用NVIDIA HDR Quantum InfiniBand的前一代產品,能以超過九倍的頻寬連接多達256個 H100 GPU。

DPX指令:與使用CPU相比,全新DPX指令將用於眾多演算法(包括路線最佳化及基因組學)的動態規畫執行速度加快高達40倍;而與使用前一代的GPU相比,速度加快了七倍。這包括為動態倉庫環境中的自主機器人車隊尋找最佳路線的Floyd-Warshall演算法,以及用於DNA和蛋白質分類及折疊的序列比對Smith-Waterman演算法。

H100的多項技術創新擴大了NVIDIA在AI推論和訓練的領先地位,使NVIDIA能夠利用巨大的AI模型做到即時和沉浸式應用。

H100讓聊天機器人可以使用全球最強大的單體transformer語言模型Megatron 530B,其傳輸量超過前一代產品達30倍,同時滿足即時對話式AI所需的次秒級延遲。H100同時讓研究人員和開發人員能夠訓練像是Mixture of Experts這類大規模模型,包含3,950億個參數,能將速度提高達九倍,將訓練時間從過去所需的數週減少到數日便能完成。

NVIDIA H100可以部署在各類型的資料中心內,包括企業內部、雲端、混合雲和邊緣。預計今年稍晚透過全球各大雲端服務供應商及電腦製造商供貨,也可以直接向NVIDIA購買。

NVIDIA第四代DGX系統DGX H100搭載八個H100 GPU,可在全新FP8精度下提供32 petaflops的AI運算表現,這個規模足以滿足大型語言模型、推薦系統、醫療研究及氣候科學的大規模運算需求。

透過第四代NVLink技術連接DGX H100系統中的每個GPU,能提供每秒900GB的連接速度,高出前一代產品1.5倍。NVSwitch技術讓八個H100 GPU能透過NVLink連接。一台外部NVLink交換器可以連接新一代NVIDIA DGX SuperPOD超級電腦中多達32個DGX H100節點。

Hopper已經獲得各大雲端服務供應商的支持,包括阿里雲、Amazon Web Services(AWS)、百度智能雲、Google Cloud、Microsoft Azure、Oracle Cloud和騰訊雲,這些業者計畫將提供基於H100的執行個體。

全球一級系統製造商預計將推出多款搭載H100加速器的伺服器產品,包括源訊(Atos)、BOXX Technologies、思科(Cisco)、戴爾科技(Dell Technologies)、富士通(Fujitsu)、技嘉(GIGABYTE)、新華三(H3C)、慧與科技(Hewlett Packard Enterprise)、浪潮(Inspur)、聯想(Lenovo)、Nettrix與美超微(Supermicro)。

H100將有SXM和PCIe兩種規格,以滿足各種伺服器的設計要求。同時也將推出一款融合加速器,將H100 GPU搭配NVIDIA ConnectX-7 400Gb/s InfiniBand及Ethernet SmartNIC。

H100 SXM規格將用於HGX H100伺服器主機板上,提供四路和八路配置,供企業在一台伺服器和多台伺服器上的應用程式擴大到多個GPU上。搭載HGX H100的伺服器為AI訓練和推論、資料分析和高效能運算應用程式提供最佳運算表現。

H100 PCIe規格使用NVLink來連接兩個GPU,提供較PCIe 5.0還要高出七倍的頻寬,為在主流企業伺服器上運行的應用程式提供出色效能。PCIe的規格尺寸讓此產品能夠輕鬆地被納入現有的資料中心基礎設施中。

全新的融合加速器H100 CNX則是將H100搭配ConnectX-7 SmartNIC,為企業資料中心的多節點AI訓練,以及邊緣的5G訊號處理等I/O密集型應用程式提供突破性的效能。

採用NVIDIA Hopper架構的GPU還能搭配NVIDIA Grace CPU,後者具備超高速NVLink-C2C互連技術,與PCIe 5.0相比,CPU與GPU之間的資料傳輸速度提高七倍以上。這樣的組合誕生出Grace Hopper超級晶片,用於巨大規模高效能運算及AI應用程式的整合模組。

NVIDIA提供強大的軟體工具來支援H100 GPU,開發人員與企業便能建立及加速AI與高效能運算各類應用程式,包括針對語音、推薦系統和超大規模推論等作業負載所推出的NVIDIA AI軟體套件重大更新。

NVIDIA還發布了超過60項CUDA-X函式庫、工具和技術更新,以加快量子運算、6G網路研究、網路安全、基因組學和藥物開發等方面的進展。

NVIDIA H100將於第三季開始供貨。