NVIDIA (輝達)今天宣布推出一款在Microsoft Azure雲端環境中執行的全新類型 GPU加速超級電腦。

|

| /news/2019/11/19/1526564230S.jpg |

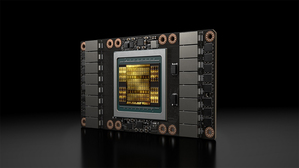

Azure為因應最苛刻的AI與高效能運算應用,以最大規模部署旗下全新NDv2執行個體,使其躋身全球最快超級電腦之一,而NDv2執行個體靠著單一Mellanox InfiniBand後端網路即可串連高達800個NVIDIA V100 Tensor核心GPU。使得客戶能夠首次在辦公桌上按照需求來租用整個AI超級電腦,享受在公司內部要花上數個月來部署大規模超級電腦才能獲得的同樣效能。

NVIDIA加速運算部門副總裁暨總經理Ian Buck 表示:「到目前為止,唯有全球最大型的企業和組織才能取得超級電腦這項資源來處理 AI 及高效能運算作業。Microsoft Azure的新產品讓更多人可以取得 AI這項基本工具,以解決世界上部分最棘手的問題。」

Microsoft Azure運算部門副總裁Girish Bablani補充道:「各地雲端運算的發展勢如破竹,客戶都想找更強大的服務。Microsoft與NVIDIA聯手讓客戶能夠立即取得強大的超級運算能力,這是過去想都想不到的,開啟了創新的新紀元。」

適用於處理複雜 AI、機器學習及高效能運算作業負載的新產品,與傳統的 CPU 運算產品相比,可以提供顯著的效能及成本優勢。需要快速解決問題的 AI 研究人員,能夠快速啟動多個 NDv2 執行個體,只要幾個小時便能完成訓練複雜的對話型 AI 模型。

Microsoft與NVIDIA的工程師在預先發佈的叢集版本上使用64個NDv2執行個體,只花了約三小時便完成訓練熱門的對話型AI模型BERT,其中有部分利用了NCCL 的多GPU優化、NVIDIA CUDA X函式庫與高速 Mellanox 互連技術。

客戶還能獲得使用多個 NDv2 執行個體來運行複雜 HPC 作業負載像是 LAMMPS 的優點。LAMMPS 是一種熱門的分子動力學應用程式,用在藥物開發和發現等領域模擬深入到原子層級的材料。對於深度學習等特定類型的應用項目,單一 NDv2 執行個體可以在不使用 GPU 加速技術的情況下,以傳統 HPC 節點難以望其項背的速度更快提供結果。這種效能表現能夠以線性方式擴大到 100 個執行個體,以處理大規模模擬作業。

所有 NDv2 執行個體皆受益於 GPU 優化的 HPC 應用程式與機器學習軟體,還有來自 NVIDIA NGC 容器 registry 與 Azure Marketplace 的 TensorFlow、PyTorch 及 MXNet 等深度學習框架。該 registry 還提供多個 Helm chart 以便在 Kubernetes 叢集上輕鬆部署 AI 軟體。