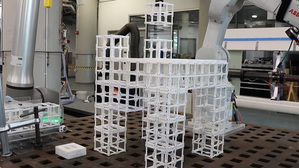

麻省理工學院(MIT)的研究團隊聯手Google DeepMind與Autodesk Research,開發出一套AI驅動的機器人組裝系統。該系統讓使用者僅需透過文字描述(例如:「幫我做一張椅子」),就能指揮機器人將預製零件組裝成實體家具,大幅降低了設計與製造的門檻。

|

| /news/2025/12/16/1700348680S.jpg |

這套系統的核心在於結合了生成式AI與視覺語言模型(VLM)。首先,生成式AI會根據用戶的文字提示建立物件的3D幾何模型;接著,VLM充當機器人的「眼睛與大腦」,負責分析物件的幾何結構與功能需求(例如辨識出椅子的座位與靠背位置),並決定組件的配置方式。最終,系統會指揮機器人利用標準化的預製零件自動完成組裝。

該研究第一作者Alex Kyaw指出,這項技術支援「人在迴路」(human-in-the-loop)的協作模式,使用者可隨時給予反饋調整設計。團隊利用此系統成功製作了椅子與架子,且由於使用可重複拆裝的預製組件,能大幅減少製造廢料。在使用者調查中,超過90%的參與者認為此AI系統設計的成品優於其他演算法的產出。

研究團隊表示,目前的成果僅是初步展示,未來計畫加入玻璃、金屬以及齒輪、鉸鏈等動態組件,以應對更複雜的設計需求。這項技術長遠來看,不僅適用於航太組件等複雜物件的快速原型製作,更有望實現家具的在地化生產,免去大型產品的長途運輸成本。